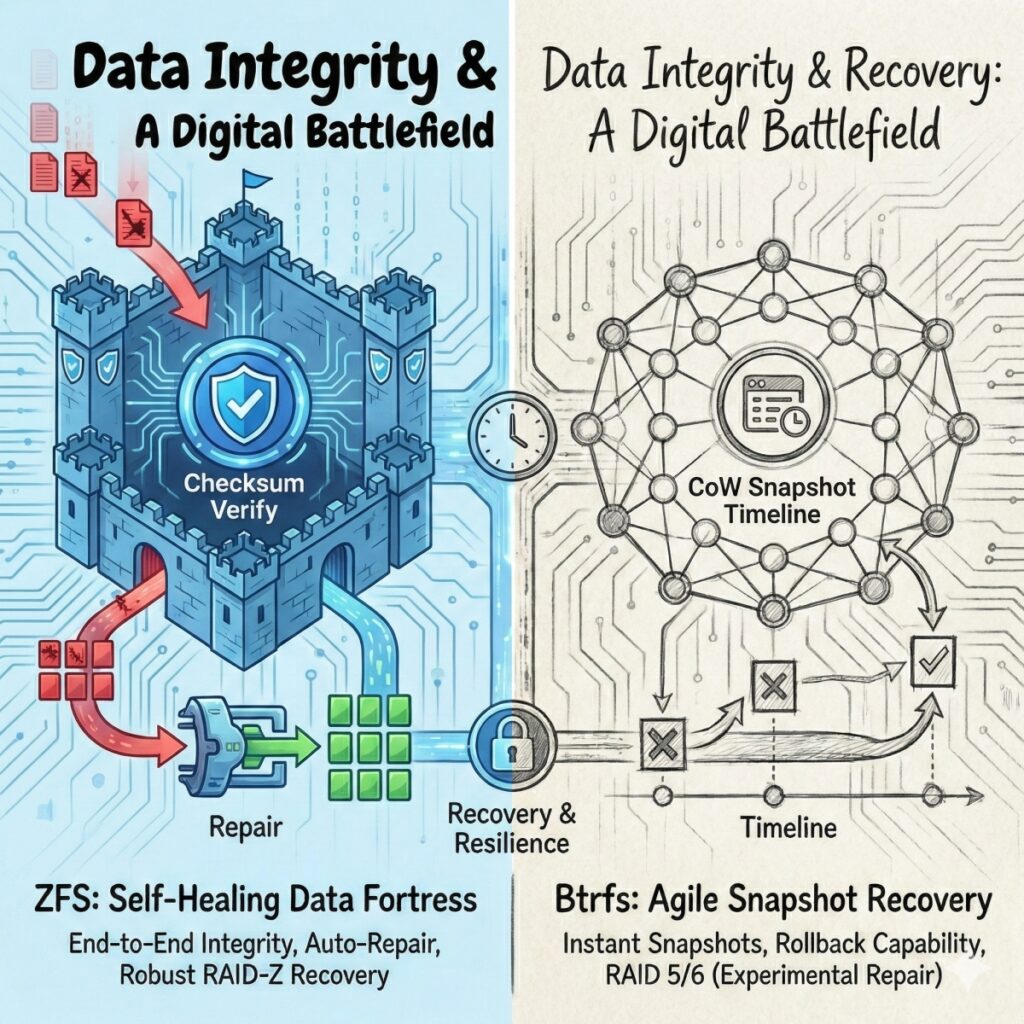

En el campo de batalla de las tecnologías modernas de almacenamiento, Btrfs y ZFS / OpenZFS sin duda se sitúan como dos de las soluciones más potentes. Aunque ambas se basan en la filosofía central de Copy-on-Write (CoW) y ofrecen capacidades de autorreparación e instantáneas, presentan un ADN de ingeniería claramente diferente a la hora de gestionar la capa física de almacenamiento (por ejemplo, RAID5/RAID50) y la expansión de dispositivos.

Analicemos las diferencias entre estos dos sistemas de archivos en cuatro dimensiones principales: mecanismos de escritura, coste de expansión, el agujero de escritura de RAID y la integridad de datos.

1. Diferencias filosóficas en los mecanismos de escritura: flexibilidad vs. eficiencia

Btrfs y ZFS adoptan estrategias fundamentalmente diferentes al gestionar las escrituras de datos, y esta distinción determina directamente sus respectivos casos de uso.

Btrfs: Relleno tipo Tetris

Btrfs abstrae los dispositivos físicos en unidades lógicas de 1 GiB conocidas como “chunks”. Este diseño le permite determinar dinámicamente el ancho de banda de la franja en el momento de la escritura según el número de discos disponibles.

La principal ventaja es una flexibilidad excepcional del hardware. Dentro de un solo conjunto, puedes mezclar unidades de diferentes capacidades, y Btrfs maximizará la utilización del espacio como si jugara al Tetris.

Desde el punto de vista arquitectónico, carece de un perfil RAID50 independiente; en su lugar, agrupa varios chunks RAID5, funcionando efectivamente como un RAID50 en paralelo.

ZFS: Lógica de rendimiento basada en transacciones

ZFS, en cambio, sigue una estrategia orientada al rendimiento. Adopta un enfoque de ancho de franja variable y determina dinámicamente la disposición de la franja para cada transacción de escritura.

La ventaja de ZFS reside en la eliminación completa del ciclo tradicional de lectura-modificación-escritura (RMW) de RAID, mejorando significativamente la eficiencia de E/S. ZFS admite escrituras de franja completa. Calcula la paridad en tiempo real en función del tamaño de datos y realiza escrituras de franja completa, asegurando que la paridad no cruce los límites de datos.

Si tu entorno está lleno de varios unidades antiguos de repuesto, la arquitectura de Btrfs es ideal para mezclar unidades de diferentes edades y capacidades. Sin embargo, si buscas el máximo rendimiento de E/S y una consistencia de nivel empresarial, la arquitectura de flujo de transacciones de ZFS ofrece una clara ventaja.

2. El coste de la expansión: reequilibrio frente a flujo dinámico de datos

Cuando la capacidad de almacenamiento se agota y se añade un nuevo disco, ¿qué ocurre? Este es uno de los aspectos más comúnmente malinterpretados por los equipos de operaciones.

El coste de una reescritura completa en Btrfs

Para utilizar el nuevo disco y lograr un ancho de franja mayor, Btrfs debe realizar la operación de balanceo de btrfs. El impacto es un proceso de reescritura completa. Para matrices de varios terabytes, este proceso puede durar varios días y generar una carga de E/S considerable.

Como resultado, solo después de que se complete el largo proceso de reescritura, la distribución de datos y el nivel de RAID se convertirán completamente.

La elegancia y los inconvenientes de ZFS: reflujo lógico

ZFS no requiere mover los datos existentes durante la expansión. Este comportamiento se denomina “sin reescritura forzada”. Bajo este mecanismo, el asignador de conjunto de ZFS (SPA) supervisa la capacidad libre y prioriza dirigir las nuevas escrituras a los (nuevos) dispositivos con más espacio libre. Esto es una forma de asignación ponderada orientada a la capacidad.

Sin embargo, existe un error común sobre la expansión: muchas personas creen erróneamente que los datos se reequilibrarán automáticamente tras la expansión. Esto es incorrecto. Los datos existentes permanecen en los discos originales, lo que provoca puntos calientes de lectura. Los IOPS de los discos añadidos recientemente aportan un beneficio limitado al acceder a esos datos existentes.

En estos casos, una mejor solución es lograr un equilibrio real realizando manualmente una reescritura de ZFS o utilizando la nueva tecnología de expansión RAIDZ. Sin embargo, debe tenerse en cuenta que, si existen instantáneas, esto puede resultar en una duplicación del uso del espacio.

En las versiones más recientes de OpenZFS, ya existen funciones como zpool remove y otras capacidades de modificación de dispositivos, junto con herramientas que pueden utilizarse para el reequilibrio. En pocas palabras, el modelo de expansión de ZFS difiere de la expansión dinámica de Btrfs, pero no es completamente estático.

En la práctica, una vez determinada la capacidad, configurarla en consecuencia y evitar futuras expansiones es una opción más adecuada. Las empresas deben estimar las especificaciones necesarias con antelación y comprar en consecuencia para evitar complicaciones futuras. Sin embargo, este también es un inconveniente de ZFS, ya que la flexibilidad para ampliar un conjunto RAID completo no es tan buena como la de Btrfs.

3. El campo de batalla principal de la integridad de datos: RAID Write Hole

El “write hole” se refiere a un riesgo crítico que ocurre cuando se produce un corte de energía durante el proceso de escritura, lo que puede resultar en una inconsistencia entre datos y la paridad.

ZFS: inmunidad estructural

ZFS previene este problema de forma inherente a nivel arquitectónico adoptando varias tecnologías. La primera son las actualizaciones atómicas: ZFS utiliza Transaction Groups (TXG) y un búfer circular. El sistema escanea el búfer circular para localizar el TXG más reciente con una “suma de comprobación válida”. Los TXG incompletos—los que se estaban escribiendo en el momento del corte de energía—se ignoran por completo y el sistema vuelve inmediatamente al último estado consistente.

El segundo es el Árbol de Merkle. Todo el sistema de archivos está estructurado como un enorme árbol de hashes, donde cualquier corrupción del datos subyacente provoca que falle la validación de la suma de comprobación en niveles superiores, evitando así la corrupción silenciosa del datos. El Uberblock actúa como el único ancla de confianza para este árbol y nunca se sobrescribe en el mismo lugar.

Btrfs: De estado experimental a la redención gracias a RST

Durante mucho tiempo, Btrfs RAID5/6 fue catalogado como “experimental” precisamente por la vulnerabilidad fatal del write hole.

Con el kernel Linux 6.2, se introdujo el RAID Stripe Tree (RST). Es una nueva estructura de árbol que gestiona la disposición física por cada extensión y fue diseñada originalmente para abordar la vulnerabilidad del write hole. Antes de esto, Btrfs dependía del ciclo completo de lectura-modificación-escritura (RMW) para verificar las sumas de comprobación, lo que resultaba en una sobrecarga de rendimiento.

Sin embargo, según la página oficial de estado de btrfs en readthedocs (a partir del kernel Linux 6.17), la mayoría de las funciones de Btrfs están marcadas como OK o Mayormente OK. RAID5/6 sigue siendo inadecuado para uso en producción y no está marcado como OK en la tabla de estado. Desde el kernel Linux 6.12, las funciones experimentales requieren que CONFIG_BTRFS_EXPERIMENTAL esté habilitado, y persisten problemas conocidos. Además, las causas subyacentes del write hole no se han eliminado por completo. La implementación actual mitiga ciertos escenarios de corrupción de escritura, pero los efectos a largo plazo aún requieren más observación.

En los kernels Linux principales actuales (por ejemplo, la serie 6.x), el soporte nativo de RAID5/6 en Btrfs ha mostrado una mejora gradual. En los últimos años, la comunidad y los desarrolladores de Btrfs han corregido errores conocidos en la implementación de RAID5/6, incluidas soluciones para condiciones de carrera y mejoras en el comportamiento de scrub. Sin embargo, la implementación principal de RAID5/6 aún no ha alcanzado una madurez o estabilidad total. En ciertos casos límite—como la recuperación de datos tras un fallo de dispositivo—aún pueden producirse problemas con la recuperación fiable.

En otras palabras, aunque el manejo de RAID5/6 en los kernels modernos se ha vuelto más maduro que en el pasado, todavía está por debajo de la robustez que ofrecen RAID1/10 o implementaciones maduras como RAID-Z en ZFS. Por ello, en discusiones técnicas, sigue siendo recomendable utilizar configuraciones RAID más estables—como RAID1/10, o RAID5/6 creado con mdadm y Btrfs por encima—como alternativas, en lugar de depender directamente de la implementación nativa de RAID5/6 de Btrfs en entornos críticos de producción.

En la práctica, se ha comprobado que aunque el kernel Linux 6.2 y posteriores mejoran ciertos aspectos del manejo de escritura y suma de comprobación de Btrfs, el write hole sigue existiendo—especialmente en casos límite que implican pérdida de energía y fallo de dispositivo. Al mismo tiempo, las operaciones de scrub y balance aún pueden ser lentas. En arreglos de gran capacidad, pueden tardar días o incluso semanas en completarse.

4. Riesgos bajo instantáneas: preocupaciones ocultas en Btrfs

Las instantáneas son una función destacada de los sistemas de archivos CoW, pero durante la expansión o reorganización del array, las instantáneas pueden convertirse en una carga. En ZFS, los conjuntos de datos y las instantáneas son entidades separadas formalmente. En cambio, los subvolúmenes y las instantáneas de Btrfs mantienen la flexibilidad de compartir el mismo espacio de nombres interno.

El riesgo con Btrfs radica en realizar una operación de balanceo mientras se mantiene un gran número de instantáneas, ya que actualizar los extensos referenciados por esas instantáneas puede provocar una explosión de referencias diferidas. Esto puede hacer que el rendimiento caiga a cero, e incluso ha habido incidentes catastróficos en los que fallos en la verificación de metadatos impidieron montar el sistema de archivos. Sin embargo, muchos de estos problemas se han mitigado en versiones más recientes de Btrfs y en versiones recientes del núcleo Linux.

La resiliencia de ZFS se refleja en el hecho de que sus punteros de bloque son inmutables. El reflow solo ajusta la disposición física en la capa RAID y es independiente de las funciones a nivel de sistema de archivos, como las instantáneas. Incluso con miles de instantáneas, ampliar el array no amenaza la integridad de los metadatos ni provoca un colapso del rendimiento.

¿Cómo deberían elegir los usuarios empresariales y domésticos?

Al evaluar la idoneidad de Btrfs en entornos empresariales, la consideración clave no es si ofrece funciones avanzadas, sino si es adecuado para servir como la base de almacenamiento capaz de soportar escenarios de peor caso. Desde una perspectiva de ingeniería, Btrfs ya es bastante maduro en configuraciones RAID1, RAID10 o de disco único y copias múltiples, y se utiliza ampliamente para discos del sistema, gestión de imágenes y escenarios de reversión de instantáneas en distribuciones Linux.

Sin embargo, cuando los requisitos de almacenamiento avanzan hacia la eficiencia de capacidad y los niveles de tolerancia a fallos más valorados por las empresas (por ejemplo, RAID5/6), el modelo de riesgo de Btrfs puede no satisfacer completamente las expectativas empresariales en cuanto a modos de fallo predecibles y fiabilidad en la recuperación de datos. Aunque Btrfs RAID5/6 ha ido resolviendo ciertos problemas conocidos en la serie 6.x del kernel Linux más utilizada actualmente, su implementación sigue estando explícitamente marcada como no recomendada para entornos de producción críticos. Esto lleva a algunas empresas a plantearse si están dispuestas a asumir una mayor incertidumbre en la gestión de incidentes, la delimitación de responsabilidades y las operaciones y el mantenimiento a largo plazo.

En general, Btrfs no es “inadecuado para uso empresarial”, pero está mejor posicionado en la capa de sistema, la capa de plataforma o dentro de arquitecturas de almacenamiento que proporcionan protección en capas superiores. Por el contrario, para escenarios que soportan datos empresariales clave, requieren años de funcionamiento estable y dependen en gran medida de la eficiencia de capacidad de RAID5/6, se deben priorizar soluciones con mayor madurez de ingeniería y controlabilidad del riesgo.

En comparación, ZFS tiene un papel más claramente definido en entornos empresariales. Su diseño central parte de la premisa de que el sistema debe soportar datos críticas a largo plazo y debe seguir manteniendo la consistencia y recuperabilidad de datos incluso bajo condiciones extremas como fallos de hardware, anomalías de energía o fallos simultáneos de varios discos.

ZFS integra el sistema de archivos y la gestión de disco en una única pila de almacenamiento. Mediante sumas de comprobación de extremo a extremo, Copy-on-Write y la estrecha integración con RAID-Z, establece modos de fallo predecibles y procesos de autorreparación maduros, que son precisamente las características de ingeniería más valoradas por las empresas.

Por lo tanto, ZFS es especialmente adecuado para almacenamiento empresariales de misión crítica, backends de Virtualización (por ejemplo, máquinas virtuales y volumen de contenedores), implementaciones de NAS a gran escala y repositorios de copias de seguridad. Esto es especialmente relevante en entornos donde se requieren arquitecturas basadas en paridad como RAID5/6 para equilibrar la eficiencia de capacidad con la integridad de datos, ya que ZFS ofrece una estabilidad superior y un comportamiento de fallo más predecible que la mayoría de los sistemas de archivos de propósito general.

Por supuesto, ZFS implica mayores exigencias de hardware, un coste total más elevado y un modelo de expansión más estricto. Sin embargo, a escala empresarial, esta filosofía de diseño de intercambiar recursos por previsibilidad suele ser más aceptable para las organizaciones preocupadas por las operaciones a largo plazo, el cumplimiento normativo y la gestión de riesgos.

Ambos sistemas de archivos tienen sus propias ventajas

Al integrar el modelo RAID-Z, ZFS proporciona sumas de comprobación de extremo a extremo y mecanismos de autorreparación, mientras que Btrfs depende principalmente de la configuración RAID y de las operaciones de scrub para la verificación. Sin embargo, Btrfs sigue presentando limitaciones y riesgos específicos en escenarios de metadatos y RAID5/6.

ZFS tiene requisitos de RAM relativamente altos, especialmente cuando la deduplicación está habilitada. Esto debe considerarse cuidadosamente durante el despliegue, ya que puede aumentar el coste total del sistema, especialmente en épocas de precios elevados de la memoria, convirtiéndose en un factor de coste importante. A cambio, también ofrece un mejor rendimiento y una mayor integridad de datos.

A continuación se muestra una comparación de las principales diferencias entre ambos sistemas de archivos:

| Sistema de archivos | Btrfs | ZFS |

| Flexibilidad de hardware | Permite mezclar discos | Más restrictivo (limitaciones de VDEV) |

| Impacto en la expansión | Alto (requiere una reescritura completa mediante balanceo) | Bajo (reorganización, no requiere reescritura, pero es necesario monitorizar los puntos calientes de lectura) |

| Protección contra Write Hole | Depende de la versión del kernel Linux (6.2+ RST) | Inmunidad arquitectónica (TXG atómico) |

| Estabilidad en la expansión de instantáneas | Riesgo (explosión de referencias diferidas) | Seguro (BP inmutable) |

Para entornos a gran escala donde la “protección datos” y la “fiabilidad a largo plazo” son prioridades innegociables, OpenZFS es la elección definitiva. Su estabilidad, junto con el Árbol de Merkle y las actualizaciones atómicas, proporciona una integridad matemáticamente verificable.

Sin embargo, para usuarios experimentados de Linux que requieren una gestión flexible de disco —por ejemplo, mezclar antiguos unidades de distintas capacidades en un laboratorio doméstico— y que se sienten cómodos gestionando la compatibilidad de versiones del kernel y detalles operativos, Btrfs ofrece una flexibilidad considerable.

Recuerde que, independientemente de cuál elija, nunca se deben usar unidades SMR en un entorno NAS. Siempre que sea posible, especifique siempre unidades CMR. Esto se debe a que los unidades SMR presentan un rendimiento de escritura aleatoria relativamente bajo, lo que los hace inadecuados para operaciones de escritura frecuentes. Los fabricantes de HDD, incluidos Western Digital y Seagate Technology, están desarrollando tecnologías de próxima generación como la grabación magnética asistida por microondas (MAMR) y la grabación magnética asistida por calor (HAMR) para superar los cuellos de botella de capacidad, y los nuevos modelos de unidad también adoptarán estas tecnologías.

Republicado con Permiso de CyberQ