Na polu bitwy nowoczesnych technologii pamięć masowa, Btrfs i ZFS / OpenZFS bez wątpienia należą do dwóch najważniejszych potęg. Chociaż oba systemy opierają się na podstawowej filozofii Copy-on-Write (CoW) i oferują funkcje samonaprawy oraz migawek, wykazują wyraźnie odmienne podejście inżynierskie w zakresie obsługi fizycznej warstwy pamięć masowa (np. RAID5/RAID50) oraz rozbudowy urządzeń.

Przyjrzyjmy się różnicom między tymi dwoma systemami plików w czterech głównych obszarach: mechanizmach zapisu, kosztach rozbudowy, problemie RAID write hole oraz integralności dane.

1. Różnice filozoficzne w mechanizmach zapisu: elastyczność kontra wydajność

Btrfs i ZFS stosują zasadniczo odmienne strategie obsługi zapisów dane, a ta różnica bezpośrednio determinuje ich zastosowania.

Btrfs: wypełnianie niczym w Tetrisie

Btrfs abstrahuje fizyczne urządzenia do logicznych jednostek o wielkości 1 GiB, zwanych „chunkami”. Takie rozwiązanie pozwala dynamicznie określać szerokość paska podczas zapisu w zależności od liczby aktualnie dostępnych dyski.

Kluczową zaletą jest wyjątkowa elastyczność sprzętowa. W ramach jednego pula można łączyć dyski o różnych pojemnościach, a Btrfs maksymalizuje wykorzystanie przestrzeni niczym gra w Tetrisa.

Architektonicznie nie posiada osobnego profilu RAID50; zamiast tego agreguje wiele chunków RAID5, efektywnie działając jak równoległy RAID50.

ZFS: logika wydajności oparta na transakcjach

ZFS natomiast stosuje strategię nastawioną na wydajność. Wykorzystuje zmienną szerokość paska i dynamicznie określa układ pasków dla każdej transakcji zapisu.

Zaletą ZFS jest całkowite wyeliminowanie tradycyjnego cyklu RAID Read-Modify-Write (RMW), co znacząco poprawia wydajność operacji I/O. ZFS obsługuje zapisy pełnopaskowe. Oblicza parzystość w czasie rzeczywistym na podstawie rozmiaru dane i wykonuje pełnopaskowe zapisy, zapewniając, że parzystość nie przekracza granic dane.

Jeśli Twoje środowisko składa się z różnych zapasowych, starszych dyski, architektura Btrfs doskonale nadaje się do mieszania dyski o różnych pojemnościach i wieku. Jeśli jednak zależy Ci na maksymalnej wydajności I/O i spójności klasy korporacyjnej, architektura przepływu transakcji ZFS ma wyraźną przewagę.

2. Koszt rozbudowy: Rebalansowanie vs. dynamiczny przepływ dane

Co się dzieje, gdy pojemność pamięć masowa się kończy i dodawany jest nowy dysk? To jeden z najczęściej niezrozumianych aspektów przez zespoły operacyjne.

Koszt pełnego przepisywania w systemie Btrfs

Aby wykorzystać nowy dysk i uzyskać szerszą szerokość paska, Btrfs musi wykonać operację btrfs balance. Skutkiem tego jest pełny proces przepisywania. W przypadku macierzy o pojemności kilku terabajtów proces ten może trwać kilka dni i generować znaczne obciążenie I/O.

W rezultacie dopiero po zakończeniu długotrwałego procesu przepisywania dystrybucja dane i poziom RAID zostaną w pełni przekonwertowane.

Elegancja i pułapki ZFS: logiczny reflow

ZFS nie wymaga przenoszenia istniejących dane podczas rozbudowy. Takie zachowanie określa się jako „brak wymuszonego przepisywania”. W tym mechanizmie alokator pula ZFS (SPA) monitoruje wolną pojemność i priorytetowo kieruje nowe zapisy na (nowe) urządzenia z większą ilością wolnego miejsca. Jest to forma alokacji ważonej zorientowanej na pojemność.

Jednak istnieje powszechne nieporozumienie dotyczące rozbudowy: wiele osób błędnie uważa, że dane zostanie automatycznie zrebalansowany po rozbudowie. To nieprawda. Istniejący dane pozostaje na oryginalnym dyski, co skutkuje hotspotami odczytu. IOPS nowo dodanych dyski przynoszą ograniczone korzyści podczas dostępu do tego istniejącego dane.

W takich przypadkach lepszym rozwiązaniem jest osiągnięcie prawdziwej równowagi poprzez ręczne przeprowadzenie przepisywania ZFS lub skorzystanie z nowej technologii RAIDZ Expansion. Należy jednak pamiętać, że jeśli istnieją migawki, może to skutkować podwojeniem zużycia przestrzeni.

W najnowszych wersjach OpenZFS dostępne są już funkcje takie jak zpool remove oraz inne możliwości modyfikacji urządzeń, a także narzędzia do równoważenia. Mówiąc prościej, model rozszerzania ZFS różni się od dynamicznego rozszerzania Btrfs, ale nie jest całkowicie statyczny.

W praktycznym użyciu, po określeniu pojemności, lepszym wyborem jest jej odpowiednia konfiguracja i unikanie dalszej rozbudowy. Przedsiębiorstwa powinny wcześniej oszacować wymagane parametry i dokonać zakupu, aby uniknąć przyszłych komplikacji. Jest to jednak również wada ZFS, ponieważ elastyczność rozbudowy całego zestawu RAID nie jest tak dobra jak w przypadku Btrfs.

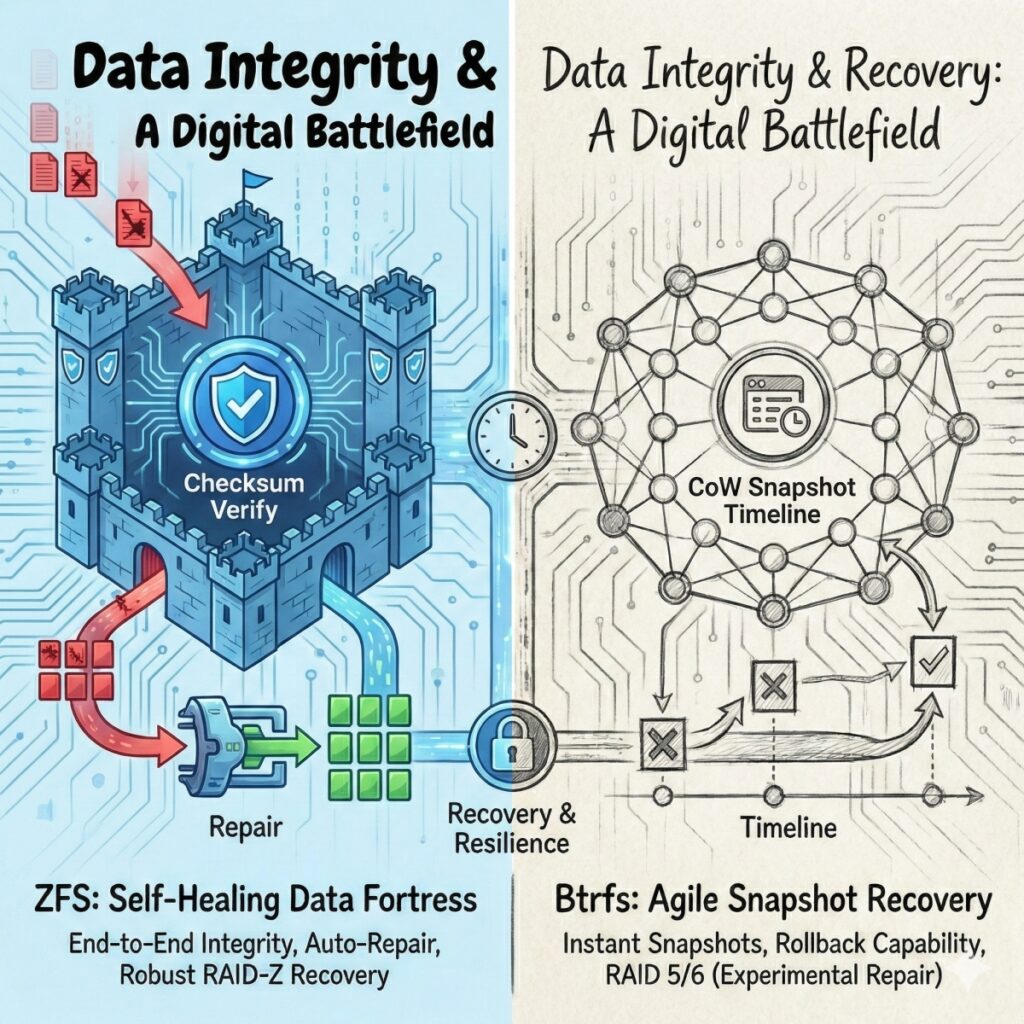

3. Kluczowe pole bitwy integralności dane: RAID Write Hole

„Write hole” odnosi się do krytycznego ryzyka, które występuje, gdy podczas procesu zapisu nastąpi awaria zasilania, co może skutkować niespójnością między dane a parzystością.

ZFS: Odporność strukturalna

ZFS z założenia zapobiega temu problemowi na poziomie architektury, stosując kilka technologii. Pierwszą z nich są aktualizacje atomowe: ZFS wykorzystuje Transaction Groups (TXG) oraz bufor pierścieniowy. System skanuje bufor pierścieniowy, aby zlokalizować najnowszy TXG z „prawidłową sumą kontrolną”. Niekompletne TXG—te zapisywane w momencie awarii zasilania—są całkowicie ignorowane, a system natychmiast wraca do ostatniego spójnego stanu.

Drugim elementem jest drzewo Merkle’a. Cały system plików jest zorganizowany jako ogromne drzewo skrótów, w którym każda korupcja niższego poziomu dane powoduje niepowodzenie weryfikacji sum kontrolnych na wyższych poziomach, zapobiegając tym samym cichej korupcji dane. Uberblock pełni rolę jedynego zaufanego punktu odniesienia dla tego drzewa i nigdy nie jest nadpisywany w miejscu.

Btrfs: Od statusu eksperymentalnego do odkupienia dzięki RST

RAID5/6 w Btrfs przez długi czas był oznaczony jako „eksperymentalny” właśnie ze względu na krytyczną podatność typu write hole.

W Linux kernelu 6.2 wprowadzono RAID Stripe Tree (RST). To nowa struktura drzewa, która zarządza fizycznym układem na poziomie pojedynczego zakresu i została pierwotnie zaprojektowana, aby rozwiązać problem podatności write hole. Wcześniej Btrfs polegał na pełnym cyklu odczyt-modyfikacja-zapis (RMW) do weryfikacji sum kontrolnych, co skutkowało narzutem wydajnościowym.

Jednak według oficjalnej strony statusu btrfs readthedocs (stan na Linux kernel 6.17), większość funkcji Btrfs jest oznaczona jako OK lub Głównie OK. RAID5/6 pozostaje nieodpowiedni do zastosowań produkcyjnych i nie jest oznaczony jako OK w tabeli statusu. Od Linux kernel 6.12, funkcje eksperymentalne wymagają włączenia CONFIG_BTRFS_EXPERIMENTAL, a znane problemy nadal występują. Ponadto, podstawowe przyczyny problemu write hole nie zostały całkowicie wyeliminowane. Obecna implementacja łagodzi niektóre scenariusze uszkodzeń zapisu, ale długoterminowe skutki nadal wymagają dalszej obserwacji.

W obecnych głównych jądrach Linux (np. seria 6.x), natywne wsparcie RAID5/6 w Btrfs wykazuje stopniową poprawę. W ciągu ostatnich kilku lat społeczność i deweloperzy Btrfs naprawili znane błędy w implementacji RAID5/6, w tym poprawki warunków wyścigu i ulepszenia działania scrub. Jednak podstawowa implementacja RAID5/6 nie osiągnęła jeszcze pełnej dojrzałości ani stabilności. W niektórych przypadkach brzegowych—takich jak odzyskiwanie dane po awarii urządzenia—mogą nadal występować problemy z niezawodnym odzyskiwaniem.

Innymi słowy, chociaż obsługa RAID5/6 w nowoczesnych jądrach stała się bardziej dojrzała niż wcześniej, nadal nie dorównuje odporności oferowanej przez RAID1/10 lub dojrzałe implementacje, takie jak RAID-Z w ZFS. W dyskusjach technicznych zaleca się więc stosowanie bardziej stabilnych konfiguracji RAID—takich jak RAID1/10 lub RAID5/6 zbudowanych za pomocą mdadm i warstwowanych z Btrfs na wierzchu—jako alternatywy, zamiast polegać bezpośrednio na natywnej implementacji RAID5/6 w Btrfs w krytycznych środowiskach produkcyjnych.

W praktyce stwierdzono, że chociaż Linux kernel 6.2 i nowsze poprawiają niektóre aspekty obsługi zapisu i sum kontrolnych w Btrfs, problem write hole nadal występuje—szczególnie w przypadkach brzegowych związanych z utratą zasilania i awarią urządzenia. Jednocześnie operacje scrub i balance mogą być nadal powolne. Na macierzach o dużej pojemności mogą trwać dni, a nawet tygodnie.

4. Ryzyka pod migawkami: Ukryte zagrożenia w Btrfs

Migawki to kluczowa funkcja systemów plików CoW, ale podczas rozszerzania lub reorganizacji macierzy mogą stać się obciążeniem. W ZFS zbiory danych i migawki są formalnie oddzielnymi bytami. Natomiast podwoluminy i migawki Btrfs zachowują elastyczność, dzieląc tę samą wewnętrzną przestrzeń nazw.

Ryzyko w Btrfs polega na przeprowadzaniu operacji równoważenia przy dużej liczbie migawek, ponieważ aktualizacja zakresów odniesionych przez te migawki może wywołać eksplozję opóźnionych referencji. Może to spowodować spadek wydajności do zera, a zdarzały się nawet katastrofalne przypadki, gdy błędy weryfikacji metadanych uniemożliwiały zamontowanie systemu plików. Jednak wiele z tych problemów zostało złagodzonych w nowszych wydaniach Btrfs i najnowszych wersjach jądra Linux.

Odporność ZFS wynika z faktu, że jego wskaźniki bloków są niezmienne. Reflow dostosowuje jedynie fizyczny układ na warstwie RAID i jest niezależny od funkcji na poziomie systemu plików, takich jak migawki. Nawet przy tysiącach migawek rozszerzanie macierzy nie zagrozi integralności metadanych ani nie spowoduje załamania wydajności.

Jak powinni wybierać użytkownicy biznesowi i domowi?

Przy ocenie przydatności Btrfs w środowiskach korporacyjnych kluczową kwestią nie jest to, czy oferuje zaawansowane funkcje, lecz czy nadaje się na fundament pamięć masowa, zdolny wytrzymać najgorsze scenariusze. Z inżynierskiego punktu widzenia Btrfs jest już dość dojrzały w konfiguracjach RAID1, RAID10, pojedynczego dysku oraz wielu kopii i jest szeroko stosowany do dyski systemu, zarządzania obrazami oraz scenariuszy przywracania migawek w dystrybucjach Linux.

Jednak gdy wymagania pamięć masowa przesuwają się w kierunku efektywności pojemnościowej i poziomu odporności na błędy najbardziej cenionych przez przedsiębiorstwa (np. RAID5/6), model ryzyka Btrfs może nie w pełni spełniać oczekiwania firm dotyczące przewidywalnych trybów awarii i niezawodności odzyskiwania dane. Chociaż Btrfs RAID5/6 stopniowo rozwiązuje pewne znane problemy w obecnej, głównej serii jądra Linux 6.x, jego implementacja jest nadal wyraźnie oznaczona jako niewskazana do krytycznych środowisk produkcyjnych. To sprawia, że niektóre firmy zastanawiają się applicable, czy są gotowe podjąć dodatkową niepewność w obsłudze incydentów, rozgraniczeniu odpowiedzialności oraz długoterminowej eksploatacji i utrzymaniu.

Ogólnie rzecz biorąc, Btrfs nie jest „nieodpowiedni do zastosowań korporacyjnych”, ale lepiej sprawdza się na warstwie systemowej, platformowej lub w architekturach pamięć masowa, które zapewniają ochronę na poziomie wyższym. Natomiast w scenariuszach, które obejmują kluczowe dane przedsiębiorstwa, wymagają wieloletniej stabilnej pracy i silnie opierają się na efektywności pojemnościowej RAID5/6, nadal należy priorytetowo traktować rozwiązania o większej dojrzałości inżynierskiej i lepszej kontroli ryzyka.

Dla porównania, ZFS ma wyraźniej określoną rolę wrodzaju środowiskach korporacyjnych. Jego podstawowe założenia projektowe opierają się na tym, że system musi przez długi czas obsługiwać krytyczne dane i nawet w sopraw ekstremalnych, takich jak awaria sprzętu, anomalie zasilania czy jednoczesne awarie wielu dysków, zachować spójność i możliwość odzyskania dane.

ZFS integruje system plików i zarządzanie dysk w jeden stos pamięć masowa. Dzięki end-to-end sumom kontrolnym, technologii Copy-on-Write oraz ścisłej integracji z RAID-Z, zapewnia przewidywalne tryby awarii i dojrzałe procesy samonaprawy, które są dokładnie tymi cechami inżynieryjnymi, które przedsiębiorstwa cenią najbardziej.

Dlatego ZFS jest szczególnie dobrze przystosowany do krytycznych zastosowań biznesowych pamięć masowa, backendów Wirtualizacja (np. maszyn wirtualnych i wolumin kontenerów), wdrożeń Serwer NAS na dużą skalę oraz repozytoriów kopii zapasowych. Dotyczy to zwłaszcza środowisk, w których wymagane są architektury oparte na parzystości, takie jak RAID5/6, aby zrównoważyć efektywność pojemności z integralnością dane, ponieważ ZFS zapewnia wyższą stabilność i bardziej przewidywalne zachowanie w przypadku awarii niż większość uniwersalnych systemów plików.

Oczywiście ZFS wiąże się z większymi wymaganiami sprzętowymi, wyższymi kosztami ogólnymi oraz bardziej rygorystycznym modelem rozbudowy. Jednak w skali przedsiębiorstwa taka filozofia projektowania, polegająca na wymianie zasobów na przewidywalność, jest często bardziej akceptowalna dla organizacji dbających o długoterminowe funkcjonowanie, zgodność z przepisami i zarządzanie ryzykiem.

Oba systemy plików mają swoje mocne strony

Podczas integracji modelu RAID-Z, ZFS zapewnia sumy kontrolne end-to-end i mechanizmy samonaprawy, podczas gdy Btrfs polega głównie na konfiguracji RAID i operacjach scrub do weryfikacji. Jednak Btrfs nadal posiada wyraźne ograniczenia i ryzyka w scenariuszach metadanych oraz RAID5/6.

ZFS ma stosunkowo wysokie wymagania dotyczące pamięci RAM, szczególnie gdy włączona jest deduplikacja. Należy to dokładnie rozważyć podczas wdrażania, ponieważ może to zwiększyć całkowite koszty systemu, zwłaszcza w czasach wysokich cen pamięci, czyniąc to istotnym czynnikiem kosztowym. W zamian zapewnia także lepszą wydajność i większą integralność dane.

Poniżej znajduje się porównanie głównych różnic między tymi dwoma systemami plików:

| System plików | Btrfs | ZFS |

| Elastyczność sprzętowa | Obsługuje mieszanie dyski | Bardziej restrykcyjny (ograniczenia VDEV) |

| Wpływ rozbudowy | Wysoki(wymaga pełnego przepisania przez balance) | Niski(reflow, nie wymaga przepisania, ale należy monitorować gorące punkty odczytu) |

| Ochrona przed Write Hole | Zależy od wersji jądra Linux (6.2+ RST) | Odporność architektoniczna(Atomic TXG) |

| Stabilność rozszerzania migawek | Ryzyko (eksplozja Delayed Refs) | Bezpieczny(Niezmienny BP) |

Dla środowisk na dużą skalę, gdzie „ochrona dane” i „długoterminowa niezawodność” są priorytetami niepodlegającymi negocjacjom, OpenZFS jest ostatecznym wyborem. Jego stabilność, wraz z drzewem Merkle i atomowymi aktualizacjami, zapewnia matematycznie weryfikowalną integralność.

Jednak dla doświadczonego użytkownika Linux, który potrzebuje elastycznego zarządzania dysk — na przykład mieszania starych dyski o różnych pojemnościach w domowym laboratorium — i który potrafi zarządzać zgodnością wersji jądra oraz szczegółami operacyjnymi, Btrfs oferuje znaczną elastyczność.

Pamiętaj, że niezależnie od wyboru, SMR dyski nigdy nie powinny być używane w środowisku Serwer NAS. Zawsze, gdy to możliwe, wybieraj CMR dyski. Wynika to z faktu, że SMR dyski charakteryzują się stosunkowo słabą wydajnością losowego zapisu, przez co nie nadają się do częstych operacji zapisu. Producenci Dysk twardy, w tym Western Digital i Seagate Technology, rozwijają technologie nowej generacji, takie jak Microwave-Assisted Magnetic Recording (MAMR) i Heat-Assisted Magnetic Recording (HAMR), aby przełamać bariery pojemności, a nowe modele dysk również będą je wykorzystywać.

Przedrukowano za zgodą Uprawnienia z CyberQ