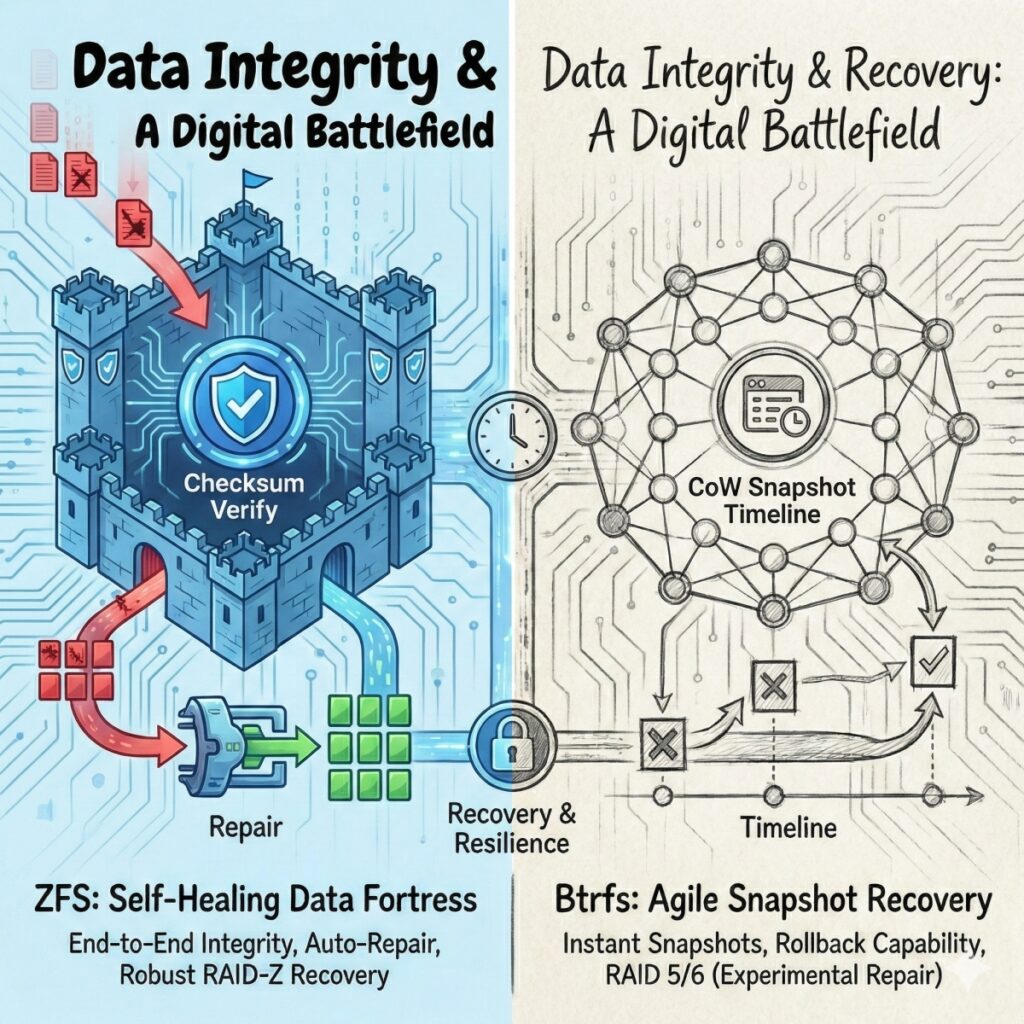

Nella battaglia delle moderne tecnologie archiviazione, Btrfs e ZFS / OpenZFS sono indubbiamente due delle soluzioni più potenti. Sebbene entrambe siano costruite sulla filosofia di base del Copy-on-Write (CoW) e offrano funzionalità di auto-riparazione e snapshot, presentano un DNA ingegneristico nettamente diverso quando si tratta del livello fisico archiviazione (ad esempio, RAID5/RAID50) e dell’espansione dei dispositivi.

Esaminiamo le differenze tra questi due file system su quattro dimensioni principali: meccanismi di scrittura, costo di espansione, il problema del RAID write hole e integrità dati.

1. Differenze filosofiche nei meccanismi di scrittura: flessibilità vs. efficienza

Btrfs e ZFS adottano strategie fondamentalmente diverse nella gestione delle scritture dati, e questa distinzione determina direttamente i rispettivi casi d’uso.

Btrfs: Riempimento stile Tetris

Btrfs astrae i dispositivi fisici in unità logiche da 1 GiB chiamate “chunk”. Questo design consente di determinare dinamicamente la larghezza dello stripe al momento della scrittura in base al numero di dischi attualmente disponibili.

Il vantaggio principale è un’eccezionale flessibilità hardware. All’interno di un singolo pool, puoi mescolare unità di capacità diverse e Btrfs massimizzerà l’utilizzo dello spazio come in una partita di Tetris.

Dal punto di vista architetturale, manca un profilo RAID50 autonomo; invece, aggrega più chunk RAID5, funzionando di fatto come un RAID50 parallelo.

ZFS: Logica di performance basata sulle transazioni

ZFS, al contrario, segue una strategia orientata alle prestazioni. Adotta un approccio a larghezza di stripe variabile e determina dinamicamente il layout dello stripe per ogni transazione di scrittura.

Il vantaggio di ZFS risiede nell’eliminazione completa del ciclo tradizionale RAID Read-Modify-Write (RMW), migliorando significativamente l’efficienza I/O. ZFS supporta scritture full-stripe. Calcola la parità in tempo reale in base alla dimensione del dati ed esegue scritture full-stripe, garantendo che la parità non attraversi i confini del dati.

Se il tuo ambiente è composto da vari unità di riserva e vecchi, l’architettura di Btrfs è adatta per mescolare unità di età e capacità diverse. Tuttavia, se cerchi il massimo throughput I/O e la coerenza di livello enterprise, l’architettura a flusso di transazioni di ZFS offre un vantaggio evidente.

2. Il costo dell’espansione: riequilibrio vs. flusso dinamico di dati

Quando la capacità di archiviazione si riduce e viene aggiunto un nuovo disco, cosa succede? Questo è uno degli aspetti più comunemente fraintesi dai team operativi.

Il costo di una riscrittura completa in Btrfs

Per utilizzare il nuovo disco e ottenere una larghezza di stripe maggiore, Btrfs deve eseguire l’operazione di bilanciamento btrfs. L’impatto è un processo di riscrittura completo. Per array di diversi terabyte, questo processo può richiedere diversi giorni e generare un carico I/O significativo.

Di conseguenza, solo dopo che il lungo processo di riscrittura è stato completato, la distribuzione di dati e il livello RAID saranno completamente convertiti.

L’eleganza e le insidie di ZFS: riflusso logico

ZFS non richiede lo spostamento dei dati esistenti durante l’espansione. Questo comportamento è chiamato “nessuna riscrittura forzata”. In questo meccanismo, l’Allocatore pool di ZFS (SPA) monitora la capacità libera e dà priorità alla scrittura di nuovi dati su dispositivi (nuovi) con più spazio libero. Si tratta di una forma di allocazione ponderata orientata alla capacità.

Tuttavia, esiste un malinteso comune sull’espansione: molte persone credono erroneamente che i dati vengano automaticamente riequilibrati dopo l’espansione. Questo è sbagliato. I dati esistenti rimangono sui dischi originali, causando hotspot di lettura. Gli IOPS dei nuovi dischi offrono benefici limitati quando si accede a quei dati esistenti.

In questi casi, una soluzione migliore è ottenere un vero bilanciamento eseguendo manualmente una riscrittura ZFS o utilizzando la nuova tecnologia di espansione RAIDZ. Tuttavia, va notato che se esistono snapshot, ciò può comportare un raddoppio dell’utilizzo dello spazio.

Nelle versioni più recenti di OpenZFS, sono già presenti funzionalità come zpool remove e altre capacità di modifica dei dispositivi, insieme a strumenti utilizzabili per il ribilanciamento. In poche parole, il modello di espansione ZFS differisce dall’espansione dinamica di Btrfs, ma non è completamente statico.

Nell’uso pratico, una volta determinata la capacità, configurarla di conseguenza ed evitare ulteriori espansioni è una scelta più adatta. Le aziende dovrebbero stimare in anticipo le specifiche necessarie e acquistare di conseguenza per evitare complicazioni future. Tuttavia, questo è anche un limite di ZFS, poiché la flessibilità nell’espansione di un intero set RAID non è pari a quella di Btrfs.

3. Il campo di battaglia principale dell’integrità dati: RAID Write Hole

Il “write hole” si riferisce a un rischio critico che si verifica quando si ha un’interruzione di corrente durante il processo di scrittura, potenzialmente causando incoerenza tra dati e la parità.

ZFS: Immunità strutturale

ZFS previene intrinsecamente questo problema a livello architetturale adottando diverse tecnologie. La prima è l’aggiornamento atomico: ZFS utilizza Transaction Groups (TXG) e un ring buffer. Il sistema scansiona il ring buffer per individuare il TXG più recente con un “checksum valido”. I TXG incompleti—quelli in scrittura al momento dell’interruzione di corrente—vengono ignorati completamente e il sistema torna immediatamente all’ultimo stato coerente.

Il secondo è il Merkle Tree. L’intero file system è strutturato come un enorme albero di hash, dove qualsiasi corruzione del dati sottostante causa il fallimento della validazione del checksum a livello superiore, impedendo così la corruzione silenziosa del dati. L’Uberblock funge da unico punto di fiducia per questo albero e non viene mai sovrascritto direttamente.

Btrfs: dallo stato sperimentale alla redenzione grazie a RST

Btrfs RAID5/6 è stato a lungo etichettato come “sperimentale,” proprio a causa della vulnerabilità fatale del write hole.

Con il kernel Linux 6.2, è stato introdotto il RAID Stripe Tree (RST). Si tratta di una nuova struttura ad albero che gestisce il layout fisico su base per-extent e originariamente è stata progettata per affrontare la vulnerabilità del write hole. Prima di questo, Btrfs si affidava al ciclo completo di read-modify-write (RMW) per verificare i checksum, causando un overhead prestazionale.

Tuttavia, secondo la pagina ufficiale Status di btrfs readthedocs (a partire dal kernel Linux 6.17), la maggior parte delle funzionalità di Btrfs sono contrassegnate come OK o Principalmente OK. RAID5/6 rimane inadatto all’uso in produzione e non è contrassegnato come OK nella tabella di stato. A partire dal kernel Linux 6.12, le funzionalità sperimentali richiedono che CONFIG_BTRFS_EXPERIMENTAL sia abilitato e permangono problemi noti. Inoltre, le cause sottostanti del write hole non sono state completamente eliminate. L’implementazione attuale mitiga alcuni scenari di corruzione della scrittura, ma gli effetti a lungo termine richiedono ancora ulteriori osservazioni.

Negli attuali kernel Linux mainstream (ad esempio, la serie 6.x), il supporto nativo RAID5/6 in Btrfs ha mostrato un miglioramento graduale. Negli ultimi anni, la comunità e gli sviluppatori di Btrfs hanno corretto bug noti nell’implementazione RAID5/6, inclusi fix per race condition e miglioramenti nel comportamento dello scrub. Tuttavia, l’implementazione core di RAID5/6 non ha ancora raggiunto piena maturità o stabilità. In alcuni casi limite—come il recupero dati dopo un guasto del dispositivo—possono ancora verificarsi problemi di recupero affidabile.

In altre parole, sebbene la gestione di RAID5/6 nei kernel moderni sia diventata più matura rispetto al passato, è ancora inferiore alla robustezza offerta da RAID1/10 o da implementazioni mature come RAID-Z in ZFS. Pertanto, nelle discussioni tecniche, è consigliabile utilizzare configurazioni RAID più stabili—come RAID1/10, oppure RAID5/6 costruito con mdadm e stratificato con Btrfs sopra—come alternative, piuttosto che affidarsi direttamente all’implementazione nativa RAID5/6 di Btrfs in ambienti di produzione critici.

In pratica, è stato riscontrato che, sebbene il kernel Linux 6.2 e successivi migliorino alcuni aspetti della gestione della scrittura e del checksum di Btrfs, il write hole persiste—soprattutto in casi limite che coinvolgono perdita di alimentazione e guasto del dispositivo. Allo stesso tempo, le operazioni di scrub e balance possono essere ancora lente. Su array di grande capacità, possono richiedere giorni o addirittura settimane per essere completate.

4. Rischi sotto Snapshot: Preoccupazioni nascoste in Btrfs

Le snapshot sono una funzione fondamentale dei file system CoW, ma durante l’espansione o la riorganizzazione dell’array, possono diventare un peso. In ZFS, dataset e snapshot sono entità formalmente separate. Al contrario, i sottovolumi e le snapshot di Btrfs mantengono la flessibilità di condividere lo stesso namespace interno.

Il rischio con Btrfs risiede nell’eseguire un’operazione di bilanciamento mentre si detiene un gran numero di snapshot, poiché l’aggiornamento degli extent referenziati da tali snapshot può innescare un’esplosione di delayed refs. Questo può causare un calo delle prestazioni fino a zero, e ci sono stati persino incidenti catastrofici in cui errori di verifica dei metadati hanno impedito il montaggio del file system. Tuttavia, molti di questi problemi sono stati mitigati nelle versioni più recenti di Btrfs e nelle ultime versioni del kernel Linux.

La resilienza di ZFS si riflette nel fatto che i suoi puntatori di blocco sono immutabili. Il reflow regola solo il layout fisico a livello di RAID ed è indipendente dalle funzionalità a livello di file system come le snapshot. Anche con migliaia di snapshot, espandere l’array non comprometterà l’integrità dei metadati né causerà un collasso delle prestazioni.

Come dovrebbero scegliere gli utenti enterprise e domestici?

Quando si valuta l’idoneità di Btrfs negli ambienti aziendali, la considerazione chiave non è se offra funzionalità avanzate, ma se sia adatto a servire come la base archiviazione in grado di resistere agli scenari peggiori. Dal punto di vista ingegneristico, Btrfs è già piuttosto maturo nelle configurazioni RAID1, RAID10, o disco singolo e multi-copia, ed è ampiamente utilizzato per dischi di sistema, gestione delle immagini e scenari di rollback snapshot nelle distribuzioni Linux.

Tuttavia, quando i requisiti archiviazione si orientano verso l’efficienza di capacità e i livelli di tolleranza ai guasti più apprezzati dalle aziende (ad esempio, RAID5/6), il modello di rischio di Btrfs potrebbe non soddisfare pienamente le aspettative aziendali per modalità di guasto prevedibili e affidabilità nel recupero dati. Sebbene Btrfs RAID5/6 abbia gradualmente risolto alcuni problemi noti nell’attuale serie di kernel Linux 6.x, la sua implementazione è ancora esplicitamente contrassegnata come non raccomandata per ambienti di produzione critici. Questo porta alcune aziende a considerare se siano disposte ad assumersi ulteriore incertezza nella gestione degli incidenti, nella definizione delle responsabilità e nelle operazioni e manutenzione a lungo termine.

Nel complesso, Btrfs non è “inadatto all’uso aziendale,” ma è meglio posizionato a livello di sistema, a livello di piattaforma, o all’interno di architetture archiviazione che forniscono protezione agli strati superiori. Al contrario, per scenari che coinvolgono dati aziendali fondamentali, richiedono anni di funzionamento stabile e dipendono fortemente dall’efficienza di capacità di RAID5/6, dovrebbero essere comunque prioritizzate soluzioni con maggiore maturità ingegneristica e controllabilità del rischio.

Al confronto, ZFS ha un ruolo più chiaramente definito negli ambienti aziendali. Il suo design centrale presuppone che il sistema debba gestire dati critici a lungo termine e debba comunque mantenere la coerenza e la recuperabilità dati anche in condizioni estreme come guasti hardware, anomalie di alimentazione o guasti simultanei di più dischi.

ZFS integra il file system e la gestione disco in un unico stack archiviazione. Tramite checksum end-to-end, Copy-on-Write e la stretta integrazione con RAID-Z, stabilisce modalità di guasto prevedibili e processi di auto-riparazione maturi, che sono esattamente le caratteristiche ingegneristiche più apprezzate dalle aziende.

Di conseguenza, ZFS è particolarmente adatto per archiviazione enterprise mission-critical, backend Virtualizzazione (ad esempio, VM e volume container), implementazioni NAS su larga scala e repository di backup. Questo è particolarmente vero in ambienti dove sono richieste architetture basate sulla parità come RAID5/6 per bilanciare l’efficienza della capacità con l’integrità dati, poiché ZFS offre una stabilità superiore e modalità di guasto più prevedibili rispetto alla maggior parte dei file system generici.

Naturalmente, ZFS comporta maggiori esigenze hardware, costi complessivi più elevati e un modello di espansione più rigoroso. Tuttavia, su scala enterprise, questa filosofia progettuale di scambiare risorse per prevedibilità è spesso più accettabile per le organizzazioni preoccupate per le operazioni a lungo termine, la conformità normativa e la gestione del rischio.

Entrambi i file system hanno i propri punti di forza

Integrando il modello RAID-Z, ZFS offre checksum end-to-end e meccanismi di auto-riparazione, mentre Btrfs si affida principalmente alla configurazione RAID e alle operazioni di scrub per la verifica. Tuttavia, Btrfs presenta ancora limitazioni e rischi distinti in scenari di metadata e RAID5/6.

ZFS richiede una quantità relativamente elevata di RAM, soprattutto quando è attivata la deduplicazione. Questo deve essere valutato attentamente durante la distribuzione, poiché può aumentare i costi complessivi del sistema, specialmente in un periodo in cui il prezzo della memoria è alto, rendendolo un fattore di costo significativo. In cambio, offre anche prestazioni migliori e una maggiore integrità dati.

Ecco un confronto delle principali differenze tra i due file system:

| File system | Btrfs | ZFS |

| Flessibilità hardware | Supporta la miscelazione di dischi | Più restrittivo (vincoli VDEV) |

| Impatto sull’espansione | Elevato (richiede una riscrittura completa tramite balance) | Basso (reflow, non è necessaria la riscrittura, ma è necessario monitorare i punti caldi di lettura) |

| Protezione Write Hole | Dipende dalla versione del kernel Linux (6.2+ RST) | Immunità architetturale (Atomic TXG) |

| Stabilità dell’espansione Snapshot | Rischio (esplosione dei Delayed Refs) | Sicuro (Immutable BP) |

Per ambienti su larga scala in cui la “protezione dati” e la “affidabilità a lungo termine” sono priorità non negoziabili, OpenZFS è la scelta definitiva. La sua stabilità, insieme al Merkle Tree e agli aggiornamenti atomici, garantisce un’integrità matematicamente verificabile.

Tuttavia, per utenti esperti di Linux che necessitano di una gestione flessibile di disco — ad esempio, miscelando vecchi unità di capacità variabile in un laboratorio domestico — e che sono a proprio agio nella gestione della compatibilità delle versioni del kernel e dei dettagli operativi, Btrfs offre una notevole flessibilità.

Ricorda che, indipendentemente da quale scegli, gli SMR unità non dovrebbero mai essere utilizzati in un ambiente NAS. Quando possibile, specifica sempre i CMR unità. Questo perché gli SMR unità offrono prestazioni di scrittura casuale relativamente scarse, rendendoli inadatti a operazioni di scrittura frequenti. I produttori di HDD, tra cui Western Digital e Seagate Technology, stanno sviluppando tecnologie di nuova generazione come Microwave-Assisted Magnetic Recording (MAMR) e Heat-Assisted Magnetic Recording (HAMR) per superare i limiti di capacità, e anche i nuovi modelli di unità adotteranno queste tecnologie.

Ripubblicato con Autorizzazione da CyberQ