Im Wettstreit moderner Speicher-Technologien Btrfs und ZFS / OpenZFS gehören zweifellos zu den führenden Schwergewichten. Obwohl beide auf der Grundphilosophie von Copy-on-Write (CoW) basieren und Funktionen wie Selbstheilung und Snapshots bieten, zeigen sie ein deutlich unterschiedliches technisches Design bei der Handhabung der physischen Speicher-Schicht (z. B. RAID5/RAID50) und der Geräteerweiterung.

Betrachten wir die Unterschiede dieser beiden Dateisysteme in vier Hauptdimensionen: Schreibmechanismen, Erweiterungskosten, das RAID Write Hole und die Daten-Integrität.

1. Philosophische Unterschiede bei den Schreibmechanismen: Flexibilität vs. Effizienz

Btrfs und ZFS verfolgen grundlegend unterschiedliche Strategien beim Umgang mit Daten-Schreibvorgängen, was ihre jeweiligen Einsatzbereiche direkt bestimmt.

Btrfs: Tetris-ähnliches Befüllen

Btrfs abstrahiert physische Geräte in 1 GiB große logische Einheiten, sogenannte „Chunks“. Dieses Design ermöglicht es, die Stripe-Breite zur Schreibzeit dynamisch anhand der aktuell verfügbaren Platten zu bestimmen.

Der Hauptvorteil ist eine außergewöhnliche Hardware-Flexibilität. Innerhalb eines einzelnen Pool können Sie Laufwerke mit unterschiedlichen Kapazitäten mischen und Btrfs nutzt den Speicherplatz maximal aus – wie bei Tetris.

Architektonisch fehlt ein eigenständiges RAID50-Profil; stattdessen werden mehrere RAID5-Chunks zusammengefasst, was effektiv wie ein paralleles RAID50 funktioniert.

ZFS: Transaktionsbasierte Performance-Logik

ZFS hingegen verfolgt eine Performance-First-Strategie. Es verwendet eine variable Stripe-Breite und bestimmt das Stripe-Layout für jede Schreibtransaktion dynamisch.

Der Vorteil von ZFS liegt in der vollständigen Eliminierung des traditionellen RAID Read-Modify-Write (RMW)-Zyklus, was die I/O-Effizienz erheblich steigert. ZFS unterstützt Full-Stripe-Writes. Die Parität wird in Echtzeit basierend auf der Größe der Daten berechnet und als Full-Stripe geschrieben, sodass die Parität nicht über Daten-Grenzen hinausgeht.

Wenn Ihre Umgebung aus verschiedenen alten Ersatz-Laufwerke besteht, ist die Architektur von Btrfs ideal, um Laufwerke unterschiedlichen Alters und Kapazität zu mischen. Wenn Sie jedoch maximale I/O-Leistung und Enterprise-Konsistenz anstreben, bietet die transaktionsbasierte Architektur von ZFS klare Vorteile.

2. Die Kosten der Erweiterung: Rebalancing vs. Dynamischer Daten-Fluss

Wenn der Speicher-Speicher knapp wird und ein neues Platte hinzugefügt wird, was passiert dann? Dies ist einer der am häufigsten missverstandenen Aspekte unter Betriebsteams.

Die Kosten einer vollständigen Neuschreibung in Btrfs

Um das neue Platte zu nutzen und eine größere Stripe-Breite zu erreichen, muss Btrfs die btrfs balance-Operation durchführen. Die Auswirkung ist ein vollständiger Neuschreibungsprozess. Bei Arrays von mehreren Terabyte kann dieser Prozess mehrere Tage dauern und erhebliche I/O-Last erzeugen.

Erst nach Abschluss des langwierigen Neuschreibungsprozesses wird die Daten-Verteilung und das RAID-Level vollständig umgewandelt.

Die Eleganz und Fallstricke von ZFS: Logischer Reflow

ZFS erfordert beim Erweitern kein Verschieben bestehender Daten. Dieses Verhalten wird als „keine erzwungene Neuschreibung“ bezeichnet. Unter diesem Mechanismus überwacht der ZFS Pool Allocator (SPA) den freien Speicher und priorisiert das Schreiben neuer Daten auf (neue) Geräte mit mehr freiem Speicherplatz. Dies ist eine kapazitätsorientierte gewichtete Zuweisung.

Es gibt jedoch einen häufigen Irrglauben bei der Erweiterung: Viele glauben fälschlicherweise, dass die Daten nach der Erweiterung automatisch neu ausbalanciert werden. Das ist falsch. Bestehende Daten verbleiben auf dem ursprünglichen Platten, was zu Lese-Hotspots führt. Die IOPS der neu hinzugefügten Platten bieten beim Zugriff auf diese bestehenden Daten nur begrenzten Nutzen.

In solchen Fällen ist eine bessere Lösung, ein echtes Gleichgewicht zu erreichen, indem Sie entweder manuell ein ZFS-Rewrite durchführen oder die neue RAIDZ Expansion-Technologie verwenden. Es sollte jedoch beachtet werden, dass bei vorhandenen Snapshots der Speicherverbrauch sich verdoppeln kann.

In den neuesten Versionen von OpenZFS gibt es bereits Funktionen wie zpool remove und andere Möglichkeiten zur Geräteänderung sowie Tools, die für das Rebalancing verwendet werden können. Einfach ausgedrückt unterscheidet sich das ZFS-Erweiterungsmodell von der dynamischen Erweiterung von Btrfs, ist aber nicht vollständig statisch.

In der Praxis ist es nach Festlegung der Kapazität sinnvoller, diese entsprechend zu konfigurieren und weitere Erweiterungen zu vermeiden. Unternehmen sollten die benötigten Spezifikationen im Voraus abschätzen und entsprechend kaufen, um zukünftige Komplikationen zu vermeiden. Dies ist jedoch auch ein Nachteil von ZFS, da die Flexibilität zur Erweiterung eines gesamten RAID-Sets nicht so gut ist wie bei Btrfs.

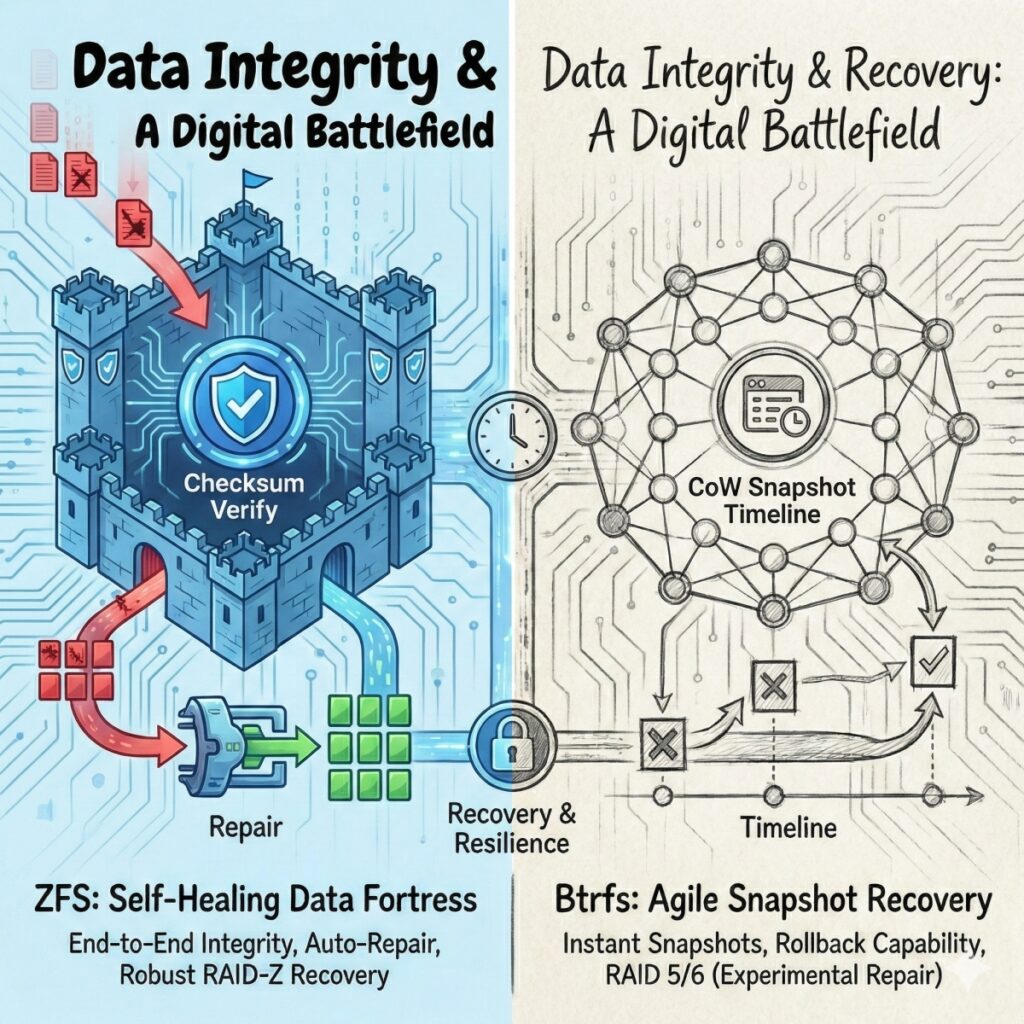

3. Das zentrale Schlachtfeld der Daten-Integrität: RAID Write Hole

Das „Write Hole“ bezeichnet ein kritisches Risiko, das auftritt, wenn während des Schreibvorgangs ein Stromausfall passiert und dadurch eine Inkonsistenz zwischen Daten und Parität entstehen kann.

ZFS: Strukturelle Immunität

ZFS verhindert dieses Problem von Grund auf durch die Verwendung mehrerer Technologien. Die erste ist das atomare Update: ZFS nutzt Transaction Groups (TXG) und einen Ringpuffer. Das System scannt den Ringpuffer, um die neueste TXG mit „gültiger Prüfsumme“ zu finden. Unvollständige TXGs—die zum Zeitpunkt eines Stromausfalls geschrieben werden—werden vollständig ignoriert und das System kehrt sofort zum letzten konsistenten Zustand zurück.

Das zweite ist der Merkle-Baum. Das gesamte Dateisystem ist als massiver Hash-Baum strukturiert, wobei jede Beschädigung des zugrunde liegenden Daten dazu führt, dass die Prüfsummenvalidierung auf höherer Ebene fehlschlägt und so eine stille Daten-Beschädigung verhindert wird. Der Uberblock dient als einziger Vertrauensanker für diesen Baum und wird niemals an Ort und Stelle überschrieben.

Btrfs: Vom experimentellen Status zur Erlösung durch RST

Btrfs RAID5/6 wurde lange Zeit als „experimentell“ eingestuft, und zwar genau wegen der fatalen Write-Hole-Schwachstelle.

Mit Linux Kernel 6.2 wurde der RAID Stripe Tree (RST) eingeführt. Es handelt sich um eine neue Baumstruktur, die das physische Layout auf Extent-Basis verwaltet und ursprünglich entwickelt wurde, um die Write-Hole-Schwachstelle zu beheben. Zuvor verließ sich Btrfs auf den vollständigen Read-Modify-Write-(RMW)-Zyklus zur Prüfsummenüberprüfung, was zu Performance-Overhead führte.

Allerdings laut offizieller btrfs readthedocs Statusseite (Stand Linux Kernel 6.17) sind die meisten Btrfs-Funktionen als OK oder größtenteils OK gekennzeichnet. RAID5/6 bleibt für den produktiven Einsatz ungeeignet und ist in der Status-Tabelle nicht als OK markiert. Ab Linux Kernel 6.12 müssen experimentelle Funktionen durch Aktivierung von CONFIG_BTRFS_EXPERIMENTAL freigeschaltet werden, und bekannte Probleme bestehen weiterhin. Außerdem wurden die zugrunde liegenden Ursachen des Write Hole nicht vollständig beseitigt. Die aktuelle Implementierung mildert bestimmte Szenarien von Schreibkorruption, aber die langfristigen Auswirkungen müssen weiterhin beobachtet werden.

In aktuellen Mainstream-Linux-Kernels (z. B. der 6.x-Serie) zeigt die native RAID5/6-Unterstützung in Btrfs eine allmähliche Verbesserung. In den letzten Jahren haben die Btrfs-Community und Entwickler bekannte Fehler in der RAID5/6-Implementierung behoben, darunter Korrekturen für Race Conditions und Verbesserungen beim Scrub-Verhalten. Die Kernimplementierung von RAID5/6 hat jedoch noch nicht volle Reife oder Stabilität erreicht. In bestimmten Randfällen—wie Daten-Wiederherstellung nach einem Geräteausfall—können weiterhin Probleme bei der zuverlässigen Wiederherstellung auftreten.

Mit anderen Worten: Obwohl die Handhabung von RAID5/6 in modernen Kerneln ausgereifter ist als früher, bleibt sie hinter der Robustheit von RAID1/10 oder ausgereiften Implementierungen wie RAID-Z in ZFS zurück. In technischen Diskussionen empfiehlt es sich daher, stabilere RAID-Konfigurationen—wie RAID1/10 oder RAID5/6, aufgebaut mit mdadm und darüber Btrfs—als Alternativen zu verwenden, anstatt sich in kritischen Produktionsumgebungen direkt auf die native RAID5/6-Implementierung von Btrfs zu verlassen.

In der Praxis hat sich gezeigt, dass Linux Kernel 6.2 und später zwar bestimmte Aspekte des Schreib- und Prüfsummenverhaltens von Btrfs verbessern, das Write Hole jedoch weiterhin besteht—insbesondere in Grenzfällen wie Stromausfall und Geräteausfall. Gleichzeitig können Scrub- und Balance-Operationen weiterhin langsam sein. Bei Arrays mit großer Kapazität können sie Tage oder sogar Wochen dauern.

4. Risiken unter Snapshots: Verborgene Probleme in Btrfs

Snapshots sind ein herausragendes Merkmal von CoW-Dateisystemen, aber während einer Array-Erweiterung oder -Umstrukturierung können Snapshots zur Belastung werden. In ZFS sind Datasets und Snapshots formell getrennte Einheiten. Im Gegensatz dazu behalten Btrfs-Subvolumes und Snapshots die Flexibilität, denselben internen Namensraum zu teilen.

Das Risiko bei Btrfs besteht darin, eine Balance-Operation durchzuführen, während eine große Anzahl von Snapshots gehalten wird, da das Aktualisieren von Extents, auf die diese Snapshots verweisen, eine Explosion verzögerter Referenzen auslösen kann. Dies kann dazu führen, dass die Leistung auf null sinkt, und es gab sogar katastrophale Vorfälle, bei denen Metadatenüberprüfungsfehler das Einhängen des Dateisystems verhinderten. Viele dieser Probleme wurden jedoch in neueren Btrfs-Versionen und aktuellen Linux Kernel-Versionen entschärft.

Die Widerstandsfähigkeit von ZFS zeigt sich darin, dass seine Blockzeiger unveränderlich sind. Reflow passt nur das physische Layout auf der RAID-Ebene an und ist unabhängig von Dateisystemfunktionen wie Snapshots. Selbst bei Tausenden von Snapshots gefährdet eine Array-Erweiterung weder die Metadatenintegrität noch führt sie zu einem Leistungseinbruch.

Wie sollten Unternehmen und Privatanwender wählen?

Bei der Bewertung der Eignung von Btrfs in Unternehmensumgebungen ist der entscheidende Aspekt nicht, ob es fortschrittliche Funktionen bietet, sondern ob es als Speicher-Grundlage geeignet ist, die Worst-Case-Szenarien standhalten kann. Aus technischer Sicht ist Btrfs bereits in RAID1-, RAID10- oder Einzelplatten- und Multi-Kopie-Konfigurationen recht ausgereift und wird häufig für System-Platten, Image-Management und Snapshot-Rollback-Szenarien in Linux-Distributionen eingesetzt.

Wenn sich die Speicher-Anforderungen jedoch in Richtung Kapazitätseffizienz und Fehlertoleranz bewegen, die von Unternehmen am meisten geschätzt werden (z. B. RAID5/6), kann das Risikomodell von Btrfs die Erwartungen von Unternehmen an vorhersehbare Ausfallmodi und Daten-Wiederherstellungszuverlässigkeit möglicherweise nicht vollständig erfüllen. Obwohl Btrfs RAID5/6 bestimmte bekannte Probleme in der aktuellen Mainstream-Linux-Kernel-6.x-Serie schrittweise adressiert hat, ist die Implementierung weiterhin ausdrücklich als nicht empfohlen für kritische Produktionsumgebungen gekennzeichnet. Dies führt dazu, dass einige Unternehmen abwägen, ob sie zusätzliche Unsicherheiten bei der Vorfallbearbeitung, der Haftungsabgrenzung und dem langfristigen Betrieb und Wartung in Kauf nehmen möchten.

Insgesamt ist Btrfs nicht „für den Unternehmenseinsatz ungeeignet“, sondern besser auf der Systemebene, der Plattformebene oder innerhalb von Speicher-Architekturen positioniert, die einen Schutz auf höheren Ebenen bieten. Im Gegensatz dazu sollten für Szenarien, die zentrale Unternehmens-Daten tragen, jahrelangen stabilen Betrieb erfordern und stark von der Kapazitätseffizienz von RAID5/6 abhängen, weiterhin Lösungen mit größerer technischer Reife und besserer Risikokontrollierbarkeit bevorzugt werden.

Im Vergleich dazu hat ZFS eine klarer definierte Rolle in Unternehmensumgebungen. Das Kerndesign geht davon aus, dass das System langfristig kritische Daten tragen muss und auch unter extremen Bedingungen wie Hardwareausfällen, Stromanomalien oder gleichzeitigen Mehrfachplattenausfällen weiterhin Daten-Konsistenz und Wiederherstellbarkeit gewährleisten muss.

ZFS integriert das Dateisystem und das Platte-Management in einen einzigen Speicher-Stack. Durch End-to-End-Prüfsummen, Copy-on-Write und die enge Kopplung von RAID-Z werden vorhersehbare Ausfallmodi und ausgereifte Selbstheilungsprozesse geschaffen – genau die technischen Eigenschaften, die Unternehmen am meisten schätzen.

Daher eignet sich ZFS besonders gut für unternehmenskritische Speicher, Virtualisierung-Backends (z. B. VMs und Container-volume), groß angelegte NAS-Bereitstellungen und Backup-Repositories. Dies gilt insbesondere in Umgebungen, in denen paritätsbasierte Architekturen wie RAID5/6 erforderlich sind, um Kapazitätseffizienz und Daten-Integrität auszubalancieren, da ZFS eine überlegene Stabilität und ein vorhersehbareres Ausfallverhalten als die meisten universellen Dateisysteme bietet.

Natürlich geht ZFS mit höheren Hardwareanforderungen, insgesamt höheren Kosten und einem strengeren Erweiterungsmodell einher. Im Unternehmensmaßstab ist diese Designphilosophie, Ressourcen gegen Vorhersehbarkeit einzutauschen, jedoch oft akzeptabler für Organisationen, die auf langfristigen Betrieb, regulatorische Compliance und Risikomanagement Wert legen.

Beide Dateisysteme haben ihre eigenen Stärken

Bei Integration des RAID-Z-Modells bietet ZFS End-to-End-Prüfsummen und Selbstheilungsmechanismen, während Btrfs hauptsächlich auf RAID-Konfiguration und Scrub-Operationen zur Verifizierung setzt. Dennoch weist Btrfs weiterhin deutliche Einschränkungen und Risiken in Bezug auf Metadaten und RAID5/6-Szenarien auf.

ZFS hat relativ hohe RAM-Anforderungen, insbesondere wenn die Deduplizierung aktiviert ist. Dies muss bei der Bereitstellung sorgfältig berücksichtigt werden, da es die Gesamtsystemkosten erhöhen kann – besonders in Zeiten hoher Speicherpreise, was es zu einem bedeutenden Kostenfaktor macht. Im Gegenzug liefert es jedoch auch bessere Leistung und stärkere Daten-Integrität.

Hier ist ein Vergleich der wichtigsten Unterschiede zwischen den beiden Dateisystemen:

| Dateisystem | Btrfs | ZFS |

| Hardware-Flexibilität | Unterstützt das Mischen von Platten | Eingeschränkter (VDEV-Beschränkungen) |

| Auswirkung auf die Erweiterung | Hoch (erfordert vollständige Neuschreibung über Balance) | Niedrig (Umbruch, keine Neuschreibung erforderlich, aber Lese-Hotspots müssen überwacht werden) |

| Write Hole Schutz | Abhängig von Linux Kernel-Version (6.2+ RST) | Architektonische Immunität (Atomare TXG) |

| Snapshot-Erweiterungsstabilität | Risiko (Delayed Refs Explosion) | Sicher (Unveränderlicher BP) |

Für große Umgebungen, in denen „Daten-Schutz“ und „langfristige Zuverlässigkeit“ nicht verhandelbare Prioritäten sind, ist OpenZFS die eindeutige Wahl. Seine Stabilität sowie der Merkle-Baum und atomare Updates bieten mathematisch nachweisbare Integrität.

Für erfahrene Linux-Nutzer, die ein flexibles Platte-Management benötigen – zum Beispiel das Mischen alter Laufwerke mit unterschiedlichen Kapazitäten in einem Home Lab – und die mit der Verwaltung von Kernel-Kompatibilität und Betriebsdetails vertraut sind, bietet Btrfs erhebliche Flexibilität.

Bitte beachten Sie, dass unabhängig von Ihrer Wahl SMR-Laufwerke niemals in einer NAS-Umgebung verwendet werden sollten. Wann immer möglich, spezifizieren Sie immer CMR-Laufwerke. Der Grund ist, dass SMR-Laufwerke eine relativ schlechte zufällige Schreib-Performance aufweisen und daher für häufige Schreibvorgänge ungeeignet sind. HDD-Hersteller, darunter Western Digital und Seagate Technology, entwickeln nächste Generationen wie Microwave-Assisted Magnetic Recording (MAMR) und Heat-Assisted Magnetic Recording (HAMR), um Kapazitätsengpässe zu überwinden, und neue Laufwerk-Modelle werden diese Technologien ebenfalls übernehmen.

Wiederveröffentlicht mit Berechtigung von CyberQ